Python 爬虫的基本步骤

- step1:获取数据

- step2:解析数据

- strp3:保存数据

1、爬取数据

- 方法一:

1 | import urllib.request |

结果:在控制台输出网页源码

- 方法二:

1 | import urllib.request |

结果:在控制台输出网页源码

2、解析数据

- 示例代码:

1 | from bs4 import BeautifulSoup |

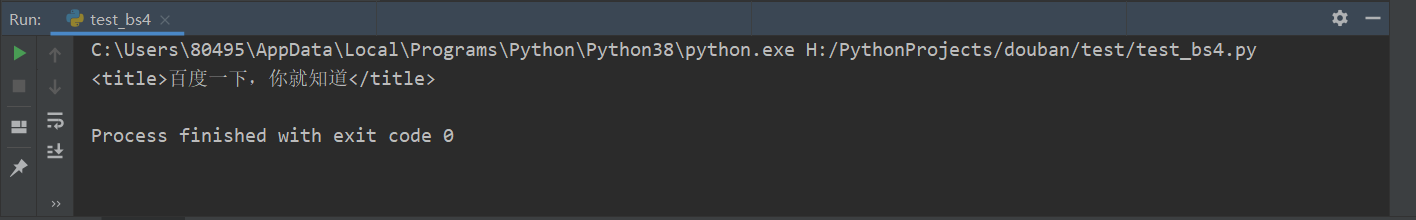

- 结果:

- 一个简单的爬取

1 | # -*- coding = utf-8 -*- |

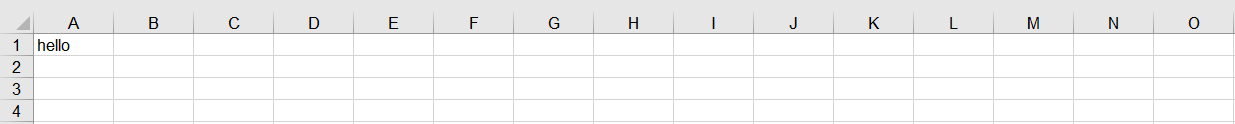

3、保存数据

1 | import xlwt |

4、拓展:正则表达式

| 操作符 | 说明 | 实例 |

|---|---|---|

| . | 表示任何单个字符 | |

| [] | 字符集,对单个字符给出取值范围 | [abc]表示a、b、c,[a-z]表示a到z单个字符 |

| [^ ] | 非字符集,对单个字符给出排除范围 | [^abc]表示非a或b或c的单个字符 |

| * | 前一个字符0次或无限次扩展 | abc*表示ab、abc、abcc、abccc等 |

| + | 前一个字符1次或无限次扩展 | abc+表示abc、abcc、abccc等 |

| ? | 前一个字符0次或1次扩展 | abc? 表示ab、abc |

| | | 左右表达式任意一个 | abc|def表示abc、def |

| {m} | 扩展前一个字符m次 | ab{2}c表示abbc |

| {m, n} | 扩展前一个字符m至n次(含n) | ab{1,2}c表示abc、abbc |

| ^ | 匹配字符串开头 | ^abc表示abc且在一个字符串的开头 |

| $ | 匹配字符串结尾 | abc$表示abc且在一个字符串的结尾 |

| () | 分组标记,内部只能使用|操作符 | (abc)表示abc,(abc|def)表示abc、def |

| \d | 数字,等价于[0-9] | |

| \w | 单词字符,等价与[A-Za-z0-9_] |

4.1 Python 中的 Re 库

4.1.1 Re 库主要功能函数

| 函数 | 说明 |

|---|---|

| re.search() | 在一个字符串中搜索匹配正则表达式的第一个位置,返回match对象 |

| re.match | 从一个字符串的开始位置期匹配正则表达式,返回match对象 |

| re.findall() | 搜索字符串,以列表类型返回全部能匹配的子串 |

| re.split() | 将一个字符串按照正则表达式匹配结果进行分割,返回列表类型 |

| re.finditer() | 搜索字符串,返回一个匹配结果的迭代类型,每个迭代元素是match对象 |

| re.sub() | 在一个字符串中替换所有匹配正则表达式的子串,返回替换后的字符串 |

4.1.2 Re 库常用修饰符

| 修饰符 | 描述 |

|---|---|

| re.I | 使匹配对大小写不敏感 |

| re.L | 做本地化识别(locale-aware)匹配 |

| re.M | 多行匹配,影响 ^ 和 $ |

| re.S | 使 . 匹配包括换行在内的所有字符 |

| re.U | 根据Unicode字符集解析字符。这个标志影响 \w, \W, \b, \B. |

| re.X | 该标志通过给予你更灵活的格式以便你将正则表达式写得更易于理解 |

- 示例代码:

1 | # 正则表达式:字符串模式 (判断字符串是否符合一定的标准) |

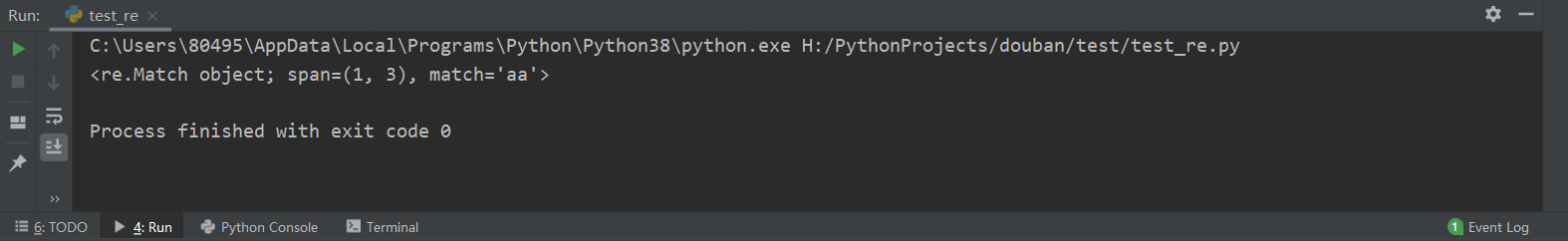

- 结果:

在正则表达式中,建议在字符串前加上 r ,这样就不用再担心转义字符的问题。例:

a = r"abc\def\gh"

5、实践项目:爬取豆瓣Top250

5.1 项目代码

1 | # -*- coding = utf-8 -*- |

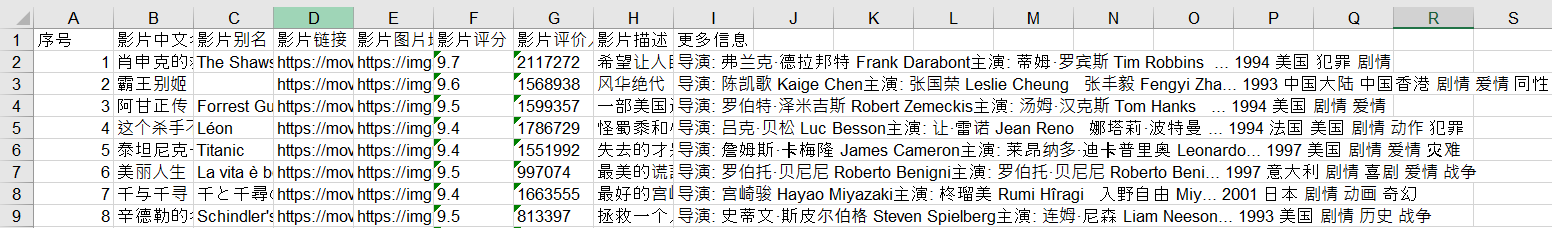

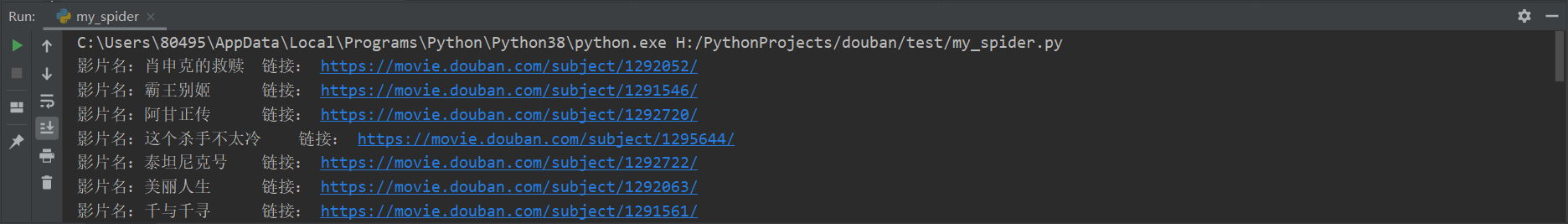

5.2 运行结果