一、简单线性回归机器学习建模思路

- 损失函数(SSE)= 预测值 - 实际值

- 最小二乘法:求出 SSE 凸函数最小值的一般方法。寻找导数为 0 的点;

通过$ y = x^2 $函数不难看出,最小值x = 0唯一存在,并且最小值点对应的函数切线与x轴平行,也就是在最小值点,函数的导数为0。这其实也凸函数求解最小值的一般方法:

a).对于一元函数,如果存在导数为0的点,则该点就是最小值点;

b).对于多元函数,如果存在某一点,使得函数的各个自变量的偏导数都为0,则该点就是最小值点。

因此,对于凸函数的最小值求解,最基本的出发点就是寻找导数为0的点。而最小二乘法也是基于偏导函数取值为0联立的方程组进行的求解。

- 驻点:导数为 0 的点,一维导数 = 0 的点

- 拐点:这个点的左右两边函数的凹凸性发生了变化,二维导数 = 0 的点

1.1 机器学习建模一般流程

- Step 1:提出基本模型

eg:用一条直线去拟合二维空间中的点。

- Step 2:确定损失函数和目标函数

很多情况下,这两者是相同的。注意:损失函数不是模型,而是模型参数所组成的一个数。

- Step 3:根据目标函数特性,选择优化方法,求解目标函数

本质是一个数学的最优化过程。

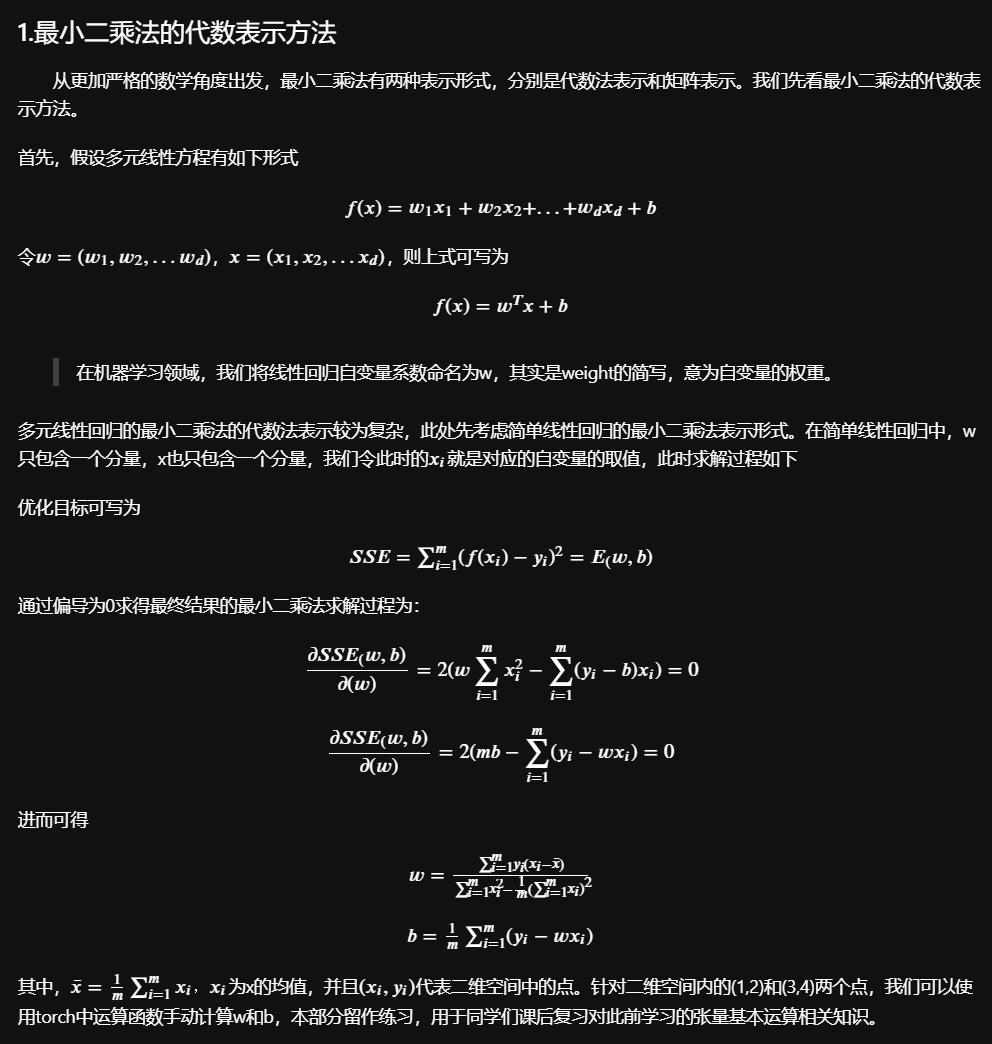

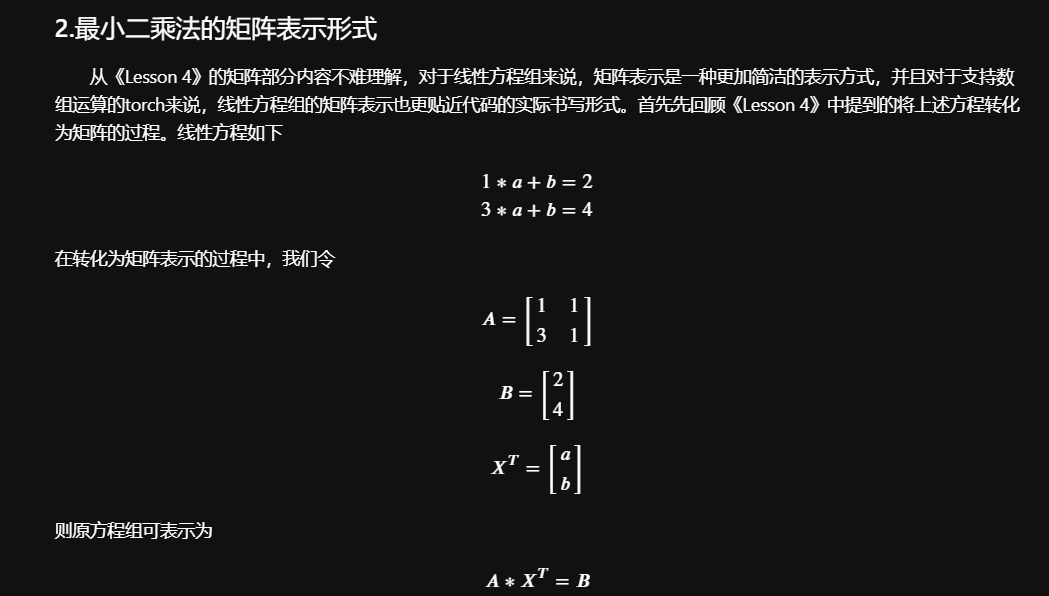

1.2 最小二乘法——第一个优化算法

两种表示方法:

1.3 autograde 求导

微分